최근 배우 박은빈이 촬영한 우유 광고가 화제가 됐다. 해당 광고는 배우 박은빈이 어린 시절의 자신과 만나는 것을 콘셉트로 하는데, 연령대가 다른 3명의 아역 배우의 외모가 박은빈과 꼭 닮은 모습이다. 어떻게 배우와 꼭 닮은 아역 배우들을 구한 것일까? 이들 아역 배우들은 실제 사람이 아니라 ‘딥페이크’ 기술을 적용한 것으로 알려졌다. 최근 딥페이크 기술은 우리 일상에서 점점 널리 쓰이고 있다.

얼굴이랑 목소리가 똑같은데…알고 보니 가짜라고?

딥페이크(Deepfake)는 인공지능(AI)을 활용한 이미지 합성기술의 일종이다. 사진이나 영상 속 인물의 얼굴에 다른 사람의 얼굴을 합성하면, 그럴싸한 가짜 이미지나 동영상을 만들어 낼 수 있다. 인물의 외모뿐만 아니라 목소리도 흡사하게 연출할 수 있어 화제가 되고 있다.

진짜 같은 가짜 영상을 만들어낼 수 있는 딥페이크 기술의 원리는 무엇일까? 특정 인물의 사진, 영상, 음성 데이터를 수집한 뒤 AI에 학습시키는 것이다. 이때 ‘생성적 적대 신경망(GAN, Generative Adversarial Network)’이라는 알고리즘을 이용한다. GAN은 두 개의 신경망으로 구성되어 있는데, 하나는 학습한 데이터를 바탕으로 새로운 이미지를 생성하는 ‘생성자’이고, 다른 하나는 생성된 이미지가 실제인지 가짜인지 구분하는 ‘판별자’다. 이 두 개의 신경망이 서로 경쟁하면서 보다 정교한 가짜 이미지를 만들어 낸다. 최근에는 기술의 발전으로 딥페이크 영상이 진짜와 구분하기 어려운 수준까지 도달했다.

문제는 딥페이크로 만든 가짜 영상이 인간의 현실 인식에 커다란 영향을 미친다는 것이다. 온라인에서 접하는 정보가 대부분 믿을 만한 것이라면 괜찮겠지만, 가짜 정보가 점점 늘어난다면 어떻게 될까? ‘아예 존재하지 않는 상황이나 인물'을 얼마든지 만들어낸다면 사회적으로 큰 혼란이 일어날 수 있으며, 반대로 거짓 정보가 범람해 중요한 진실이 묻힐 수도 있다.

딥페이크 기술은 우리의 삶에 미칠 명과 암을 만들고 있다.

세상을 속이는 딥페이크…피해자가 점점 늘어난다

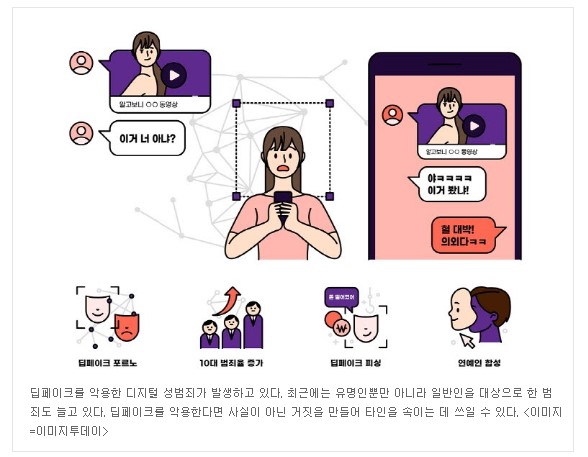

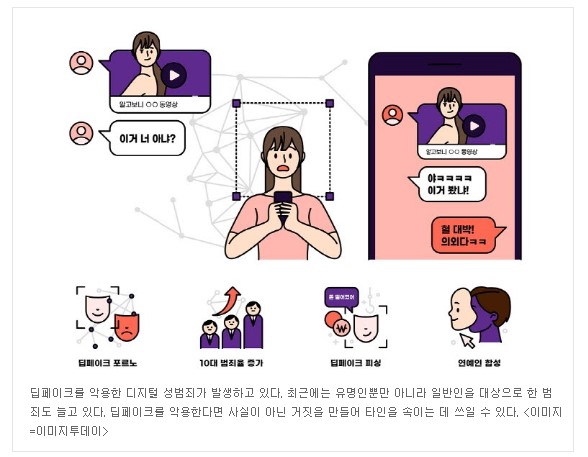

딥페이크는 존재하지 않는 상황이나 인물, 즉 사실이 아닌 것을 그럴싸하게 만들어내는 데 특화되어 있다. 이를 악용한다면 사실이 아닌 거짓을 만들어 타인을 속이는 데 쓰일 수도 있다.

첫째, 유명인을 대상으로 가짜 콘텐츠를 만들어 허위 정보를 유포하는 등 명예훼손의 우려가 있다. 유명인은 얼굴과 목소리가 대중에 널리 알려진 만큼 딥페이크의 재료가 되는 데이터가 충분하며, 그 유명세만큼 많은 사람들의 주목을 끌기도 쉽다. 지난 2월에는 세계적인 팝스타 테일러 스위프트가 딥페이크 음란물 피해를 입기도 했다. 딥페이크 영상이 각종 소셜미디어에 널리 퍼질 경우 수습하기가 더욱 어렵다.

둘째, 딥페이크 영상을 이용한 가짜 뉴스 문제를 들 수 있다. 딥페이크 영상은 상대방을 비방하기 위한 목적으로 악용될 수 있으며, 텍스트로 된 뉴스보다 파급력이 훨씬 크다. 최근에는 자신을 고급 스포츠카 브랜드의 대리점 직원이라고 소개한 한 남성이 “우크라이나의 대통령 영부인인 올레나 젤렌스키 여사가 67억원 상당의 스포츠카를 구매했다”라고 주장하는 영상이 퍼졌다. 이 영상은 X(구 트위터)에서 1800만이 넘는 조회수를 기록했지만, 딥페이크로 만들어진 가짜 영상으로 판명이 났다.

셋째, 딥페이크를 악용한 디지털 성범죄다. 최근에는 유명인뿐만 아니라 일반인을 대상으로 한 범죄도 늘고 있다. 지난 5월에는 서울대 출신 남성들이 대학 동문을 비롯한 피해자 수십 명을 대상으로 합성 음란물을 제작, 유포, 협박한 혐의로 경찰에 체포됐다. 방송통신심의위원회(방심위)에 따르면, 방심위가 딥페이크 등 성적 허위 영상물을 차단하거나 삭제해 달라고 요구한 사례는 2020년 473건에서 지난해 7187건으로 15배 가까이 늘어난 것으로 알려졌다. 방심위가 올해 6월까지 시정 요구한 성적 허위 영상물은 총 6071건에 이른다.

넷째, 피싱을 비롯한 등 금융사기다. 보이스피싱도 사회적으로 악영향이 큰데, 동영상의 경우 텍스트나 음성보다 영향력이 더욱 크다. 최근 SNS에서 유명인을 사칭해 투자를 권유하는 불법 광고가 판을 쳤는데, 이러한 사기가 딥페이크 영상을 등에 업고 이뤄진다면 파급력이 클 것이다. SNS에 올린 가족 사진이나 음성이 포함된 동영상이 자칫하면 딥페이크 사기 행각에 이용될 가능성도 있다. 최근에는 모르는 번호로 걸려오는 전화를 받을 경우 먼저 목소리를 노출하지 말라는 조언도 이어지고 있다. 적은 양의 목소리라도 이를 복제해, 딥페이크로 자연스러운 음성을 구현하는 데 악용할 수 있기 때문이다.

다섯째, 딥페이크로 만든 콘텐츠가 저작권 및 퍼블리시티권을 침해할 수 있다는 우려도 있다. 최근 유튜브에서 기존 노래에 유명 배우나 가수의 목소리를 덧씌운 ‘AI 커버곡’이 인기를 끌고 있다. AI가 가수의 목소리와 창법 데이터를 학습하면 해당 가수가 노래를 부른 것처럼 만들 수 있다. 최근 AI 커버곡을 만드는 것이 놀이처럼 즐기는 문화로 자리잡았는데, 이는 가수와 작사가, 작곡가의 동의를 받지 않은 콘텐츠라는 점에서 문제가 크다. 중기이코노미 안수영 기자

<저작권자 ⓒ 중기이코노미. 무단전재 및 재배포 금지>